在人工智能(AI)蓬勃發(fā)展的今天,人們常常幻想能夠創(chuàng)造出一種‘永遠(yuǎn)穩(wěn)定’的AI系統(tǒng)——它既能完美執(zhí)行任務(wù),又能在任何情況下都保持可靠、可預(yù)測,且不會產(chǎn)生意外的副作用。從算法、數(shù)學(xué)和計算機科學(xué)的基礎(chǔ)視角深入分析,這個目標(biāo)近乎一個‘不可能三角’。開發(fā)這樣的系統(tǒng),不僅是技術(shù)挑戰(zhàn),更觸及了理論與認(rèn)知的邊界。

一、算法的本質(zhì):復(fù)雜性與不確定性的平衡

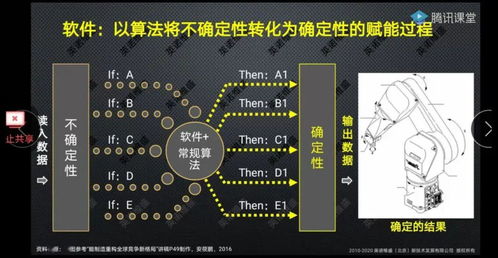

算法是AI的行為藍(lán)圖。現(xiàn)代AI,尤其是基于深度學(xué)習(xí)的系統(tǒng),其核心算法依賴于從海量數(shù)據(jù)中學(xué)習(xí)復(fù)雜的模式。這種學(xué)習(xí)過程本身就引入了不穩(wěn)定性。

- 過擬合與欠擬合:算法在訓(xùn)練數(shù)據(jù)上表現(xiàn)完美,未必能在未知數(shù)據(jù)上保持穩(wěn)定。過擬合使其變得‘脆弱’,對微小擾動過度敏感;而欠擬合則導(dǎo)致其能力不足,無法應(yīng)對復(fù)雜情況。這是一個根本的權(quán)衡。

- 黑箱特性:深度神經(jīng)網(wǎng)絡(luò)的決策過程通常難以解釋。即使輸入有微小變化,也可能通過層層非線性變換,導(dǎo)致輸出發(fā)生難以預(yù)測的‘跳躍’。這種內(nèi)在的不透明性,使得驗證其在所有可能場景下的穩(wěn)定性變得極其困難。

- 對抗性攻擊:研究表明,通過刻意添加人眼難以察覺的擾動,就能輕易欺騙最先進的圖像識別AI。這暴露了算法決策邊界的高維復(fù)雜性中存在‘盲點’,絕對穩(wěn)定性在對抗性環(huán)境中幾乎無法保證。

二、數(shù)學(xué)的局限:可計算性、邏輯與不完備性

數(shù)學(xué)為AI提供了形式化框架,但也劃定了其能力的理論邊界。

- 計算復(fù)雜性理論:許多現(xiàn)實世界的問題是NP難(NP-hard)的,意味著沒有已知算法能在多項式時間內(nèi)對所有實例給出最優(yōu)解。要求AI在所有此類問題上都‘穩(wěn)定’地給出完美答案,等同于要求它解決計算機科學(xué)中最深刻的開放性問題。

- 哥德爾不完備性定理:在足夠復(fù)雜的公理系統(tǒng)中,總存在既不能被證明也不能被證偽的命題。這意味著,對于一個足夠復(fù)雜的AI系統(tǒng)(其內(nèi)部邏輯可視為一個形式系統(tǒng)),我們無法從數(shù)學(xué)上證明其內(nèi)部邏輯在所有情況下都是完全一致和無矛盾的。可能存在其自身無法‘想通’或會導(dǎo)致矛盾的情境。

- 歸納問題的哲學(xué)困境:AI從有限經(jīng)驗中學(xué)習(xí)普遍規(guī)律,這基于歸納法。但大衛(wèi)·休謨指出,歸納法無法得到邏輯上的絕對證明。AI對未來或未知情況的預(yù)測,本質(zhì)上是基于‘過去一直如此,所以未來也會如此’的信念,而非絕對的邏輯必然。

三、計算機系統(tǒng)的現(xiàn)實:軟件工程與物理世界的約束

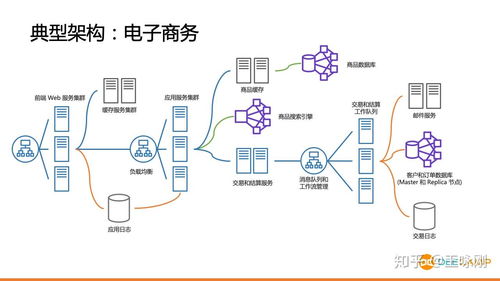

AI作為軟件,運行在物理的計算機系統(tǒng)之上,這帶來了另一層不穩(wěn)定性。

- 軟件缺陷(Bugs):歷史上沒有任何一個復(fù)雜軟件系統(tǒng)被證明是完全沒有錯誤的。AI基礎(chǔ)軟件棧極其復(fù)雜,涉及操作系統(tǒng)、編譯器、庫、框架以及AI模型本身。任何一層未被發(fā)現(xiàn)的缺陷都可能導(dǎo)致不可預(yù)測的行為。

- 硬件限制與隨機性:硬件故障(如宇宙射線導(dǎo)致的內(nèi)存位翻轉(zhuǎn))、計算精度限制(浮點數(shù)誤差)、以及并發(fā)系統(tǒng)中的競態(tài)條件,都會給確定性帶來挑戰(zhàn)。追求絕對的穩(wěn)定性,可能需要容錯能力達(dá)到物理極限。

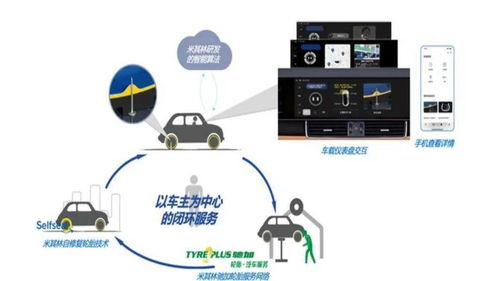

- 與現(xiàn)實世界的交互:真正的智能體需要與持續(xù)變化、充滿噪聲和不確定性的物理世界互動。傳感器數(shù)據(jù)不完美,執(zhí)行器有誤差,環(huán)境模型永遠(yuǎn)是不完整的。要求在此環(huán)境中‘永遠(yuǎn)穩(wěn)定’,相當(dāng)于要求系統(tǒng)擁有上帝視角般的全知全能。

四、人工智能基礎(chǔ)軟件開發(fā)的挑戰(zhàn):目標(biāo)定義的困境

‘永遠(yuǎn)穩(wěn)定’這個目標(biāo)本身可能就存在邏輯問題。

- 目標(biāo)的沖突與價值對齊:如何形式化地定義一個‘正確’或‘穩(wěn)定’的目標(biāo)?多個子目標(biāo)可能沖突(如效率與安全)。更重要的是,人類的價值觀復(fù)雜、模糊且動態(tài)變化。將一套固定的、無歧義的、能覆蓋所有倫理困境的目標(biāo)函數(shù)‘刻入’AI,是目前無法解決的‘價值對齊’難題。

- 分布外泛化:AI在訓(xùn)練數(shù)據(jù)分布內(nèi)表現(xiàn)穩(wěn)定,但世界會變化,會出現(xiàn)前所未有的‘分布外’情況。要求系統(tǒng)對此也能穩(wěn)定處理,就是要求它具備超越其訓(xùn)練經(jīng)驗的通用智能和常識推理能力——這正是AI研究的終極目標(biāo),遠(yuǎn)未實現(xiàn)。

- 安全與能力的張力:極度保守、為避免任何錯誤而設(shè)計的系統(tǒng),其能力可能被嚴(yán)重束縛(例如,因害怕出錯而拒絕行動)。反之,強大而靈活的智能體,其行為邊界更難被完全限定。

結(jié)論:從追求‘絕對穩(wěn)定’轉(zhuǎn)向‘韌性管理’

因此,說‘不能開發(fā)出永遠(yuǎn)穩(wěn)定的人工智能’,并非刻意唱衰,而是基于算法、數(shù)學(xué)和計算機科學(xué)基礎(chǔ)的清醒認(rèn)知。這提醒我們,AI開發(fā)的重點不應(yīng)是追求一個神話般的、絕對可靠的‘完整體’,而應(yīng)是:

- 設(shè)計具備韌性的系統(tǒng):使其在出錯時能安全降解、易于中斷、行為可解釋。

- 建立多層防護與驗證:通過形式化驗證、持續(xù)監(jiān)控、冗余設(shè)計和人機協(xié)作來管理風(fēng)險。

- 保持謙遜與迭代:承認(rèn)系統(tǒng)的局限性,將其視作需要不斷學(xué)習(xí)和調(diào)整的‘合作伙伴’,而非一勞永逸的‘終極解決方案’。

人工智能的旅程,是與不確定性共舞的藝術(shù)。理解其不可消除的不穩(wěn)定根源,恰恰是我們能夠安全、負(fù)責(zé)任地推動其進步的前提。